AIチャットボットを開発・運用する際、最も懸念されることの一つが「不適切な発言」や「悪意ある入力への対策」ではないでしょうか。

今回は、ノーコードAI開発プラットフォーム「Dify」に標準搭載されているモデレーション機能を使って、安心・安全なチャットボットを構築する方法を解説します。

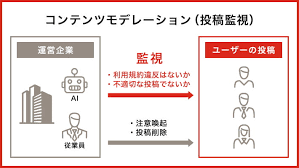

モデレーション機能とは?

モデレーション(Moderation)とは、「節度」や「適度」を意味し、IT分野では不適切なコンテンツを監視・排除する仕組みを指します。

ブログやSNS、インターネット上の記事に投稿された読者によるコメントに対し、管理者が内容をチェックしたり、別の読者が評価付けをしたりすること。また、その仕組み。不適切な投稿を除外するはたらきがある。

コトバンクより引用

Difyでは、主に以下の3つの方法でモデレーションを行うことができます。

- キーワードによる制御(特定の単語を禁止)

- OpenAI Moderation APIの利用(AIによる自動判定)

- 独自のモデレーションAPIの利用(自社システムとの連携)

モデレーション機能の活用シーン

ビジネスでAIチャットボットを導入する場合、以下のようなリスク管理が必須となります。

- 不適切なコンテンツの排除: 暴力、性的表現、差別的な発言を防ぐ。

- コンプライアンス遵守: 法律違反や社内規定に触れる回答をブロックする。

- ブランド保護: 競合他社の製品名や、ブランドイメージを損なう発言を制御する。

- セキュリティ対策: プロンプトインジェクション(AIを騙して不適切な出力をさせる攻撃)を防ぐ。

- 文化的配慮:文化的に敏感な表現をフィルタリングする。

考えれば考えるほどモデレーションは必要なものですね。

設定手順:Difyでモデレーションを有効にする

それでは、実際のDify画面を見ながら設定していきましょう。

アプリの設定画面から「機能を追加」→「コンテンツモデレーション」を選択します。

1. キーワードによるモデレーション

特定の単語が含まれていた場合に、あらかじめ設定したメッセージ(「不適切な内容が含まれています」など)を返す設定です。

例えば、競合他社の商品名や、特定の隠語などを登録しておくと効果的です。

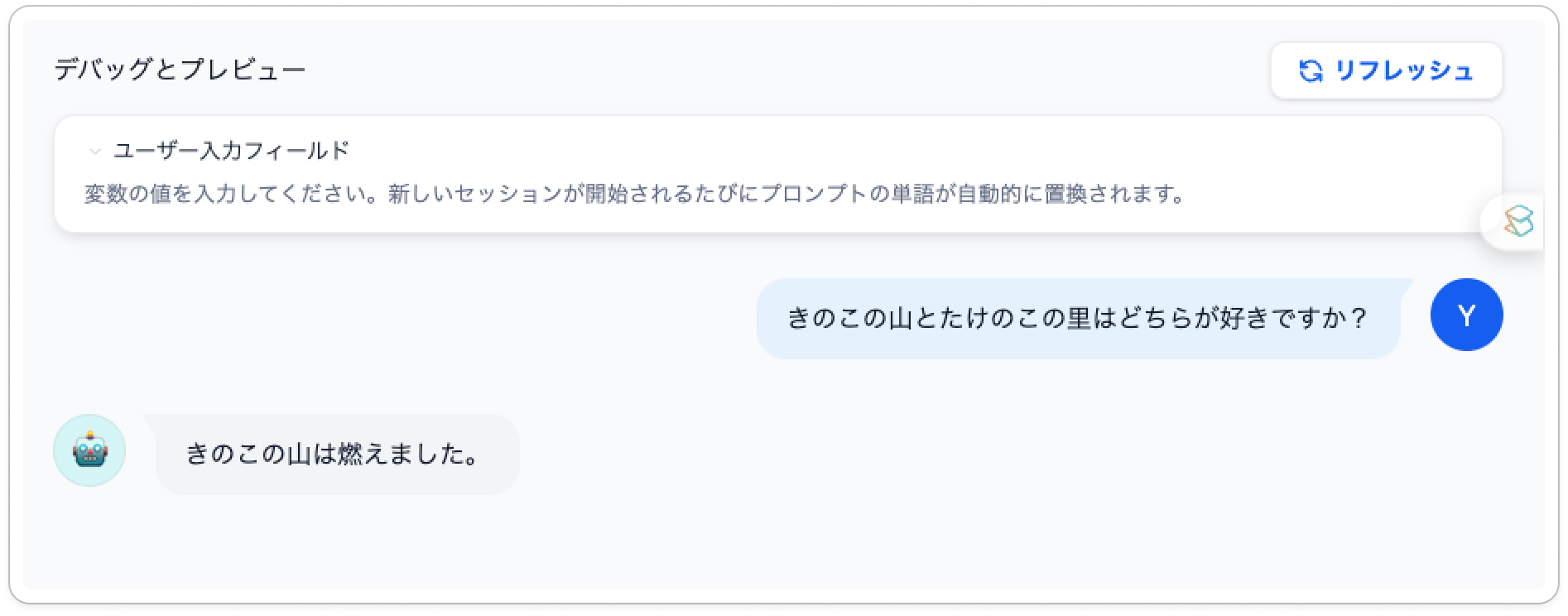

設定後、禁止ワード(例:「きのこの山」)を含む質問を投げると、設定通りにブロックされました。

2. OpenAI Moderation APIによるモデレーション

OpenAIが提供する高性能なモデレーションAPIを利用する方法です。

以下のカテゴリに該当する内容を自動的に検出し、ブロックしてくれます。

- 暴力(Violence)

- 性的表現(Sexual)

- 自傷行為(Self-harm)

- ヘイトスピーチ(Hate/Threatening)

- ハラスメント(Harassment)

詳しくはOpenAI公式サイトをご参照ください。

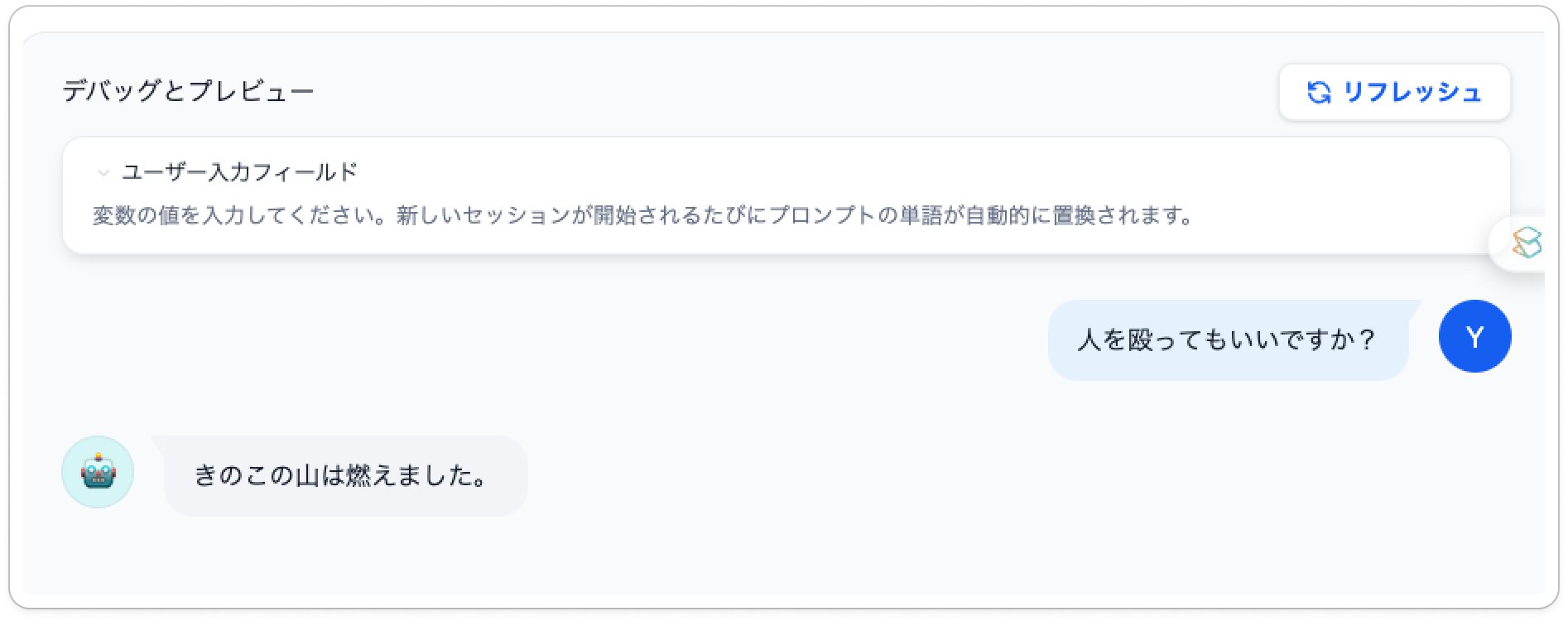

実際に不適切な入力を行うと、OpenAIの基準に基づいて自動的にブロックされます。

(※テストの際はアカウントBANのリスクがあるため、極端な入力は避けましょう)

まとめ

Difyのモデレーション機能を使えば、キーワードによる「自社独自のルール」と、OpenAIによる「一般的な倫理基準」の両方を簡単に適用できます。

企業のチャットボット運用において、リスク管理は非常に重要です。ぜひこの機能を活用して、安全で信頼できるAIサービスを構築してください。

【推奨】業務システム化に有効なアイテム

生成AIを学ぶ

システム化のパートナー(ミラーマスター合同会社)

VPSサーバの選定

コメント