「自社のAIチャットボットが、不適切な回答をしたらどうしよう…」

「社内機密に関わるワードが含まれていたら、ブロックしたい」

企業でAIを導入する際、最も懸念されるのが「セキュリティとコンプライアンス」です。

Difyには、こうしたリスクを未然に防ぐための強力な機能「コンテンツモデレーション(審査)」が備わっています。

この記事では、DifyでAIの入出力を監視し、安全なチャットボットを構築する3つの方法を解説します。

目次

コンテンツモデレーションとは?

ユーザーが入力した内容や、AIが生成した回答を自動的にチェックし、問題がある場合にブロックしたり、別のメッセージに置き換えたりする機能です。

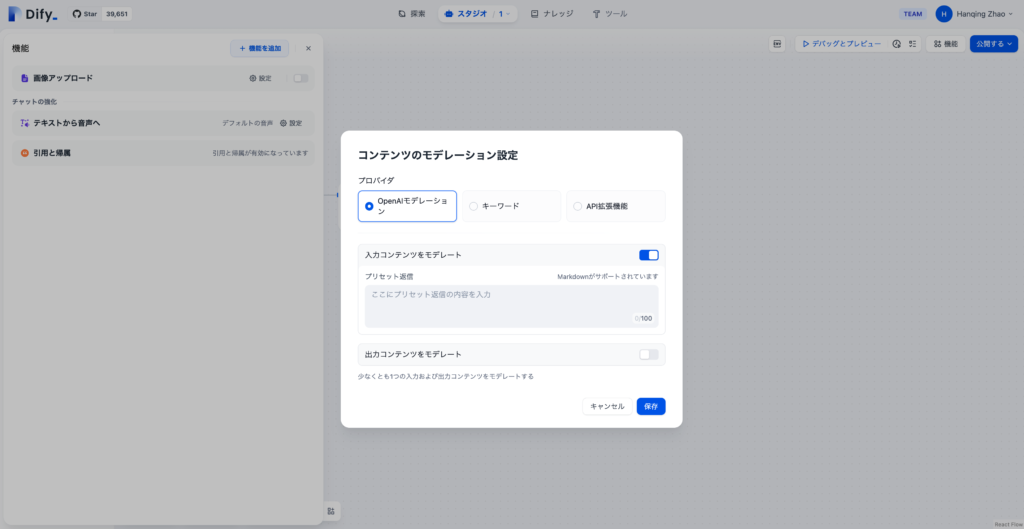

Difyの「機能を追加」メニューから簡単に設定できます。

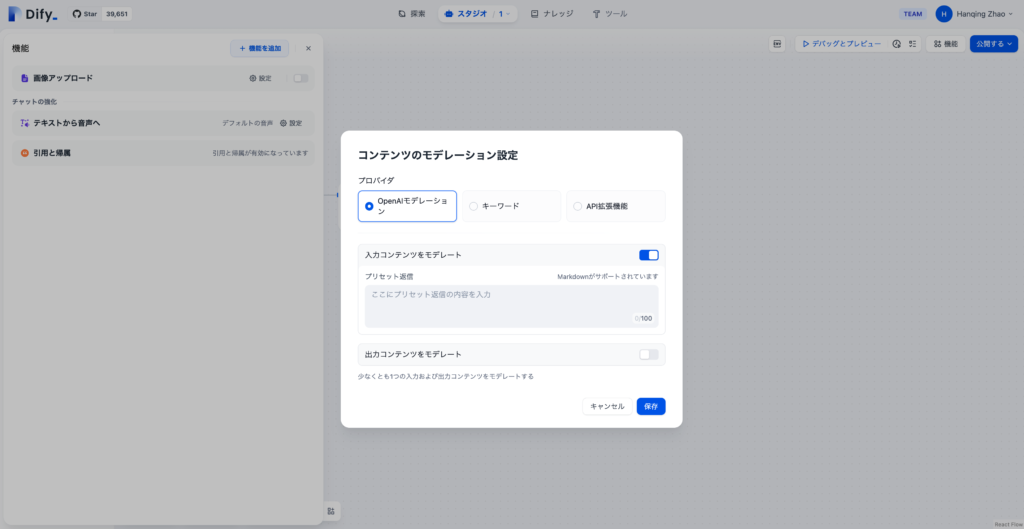

1. OpenAI モデレーションAPIの活用

OpenAIが提供している無料の審査APIを利用する方法です。

暴力、性表現、自傷行為、差別的な発言などを自動的に検出し、ブロックします。

設定方法:

「OpenAI Moderation」を選択し、違反が検出された際に表示する「プリセット応答(例:不適切な内容が含まれているため回答できません)」を入力するだけです。

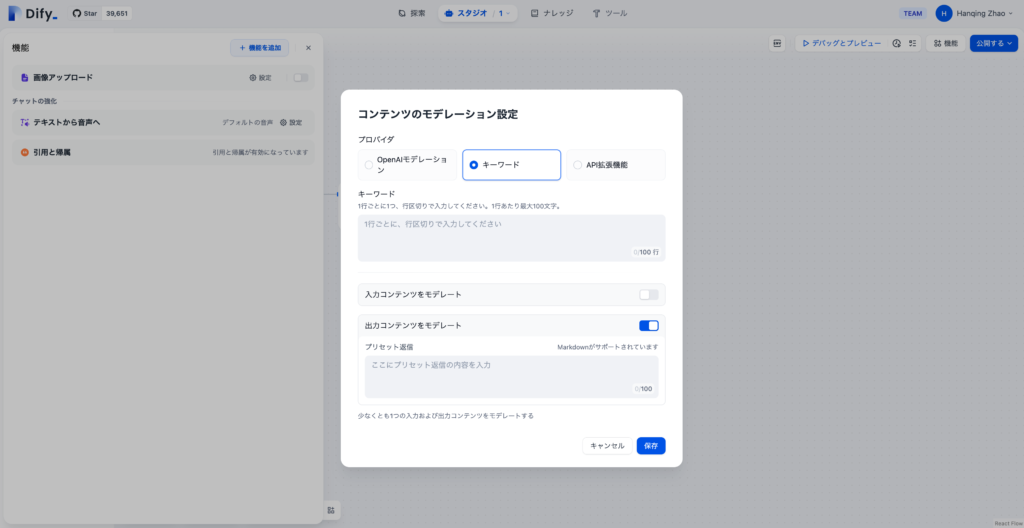

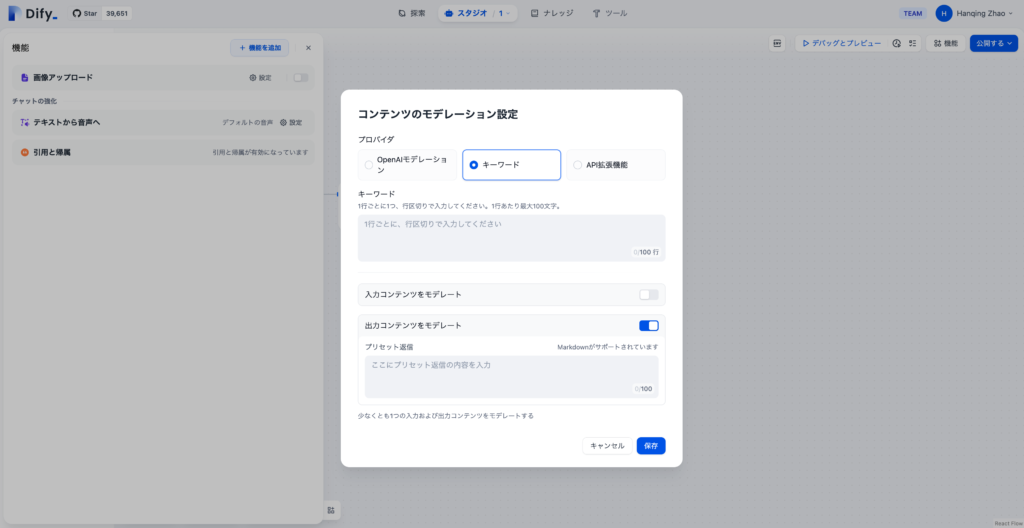

2. カスタムキーワード(NGワード)設定

特定の単語が含まれていた場合に、回答をブロックする機能です。

社内独自の禁止用語や、競合他社名などを登録しておくことで、不用意な回答を防ぐことができます。

活用例:

キーワードに「kill」や「機密プロジェクトA」などを設定し、それらが含まれていた場合の返答メッセージを設定します。

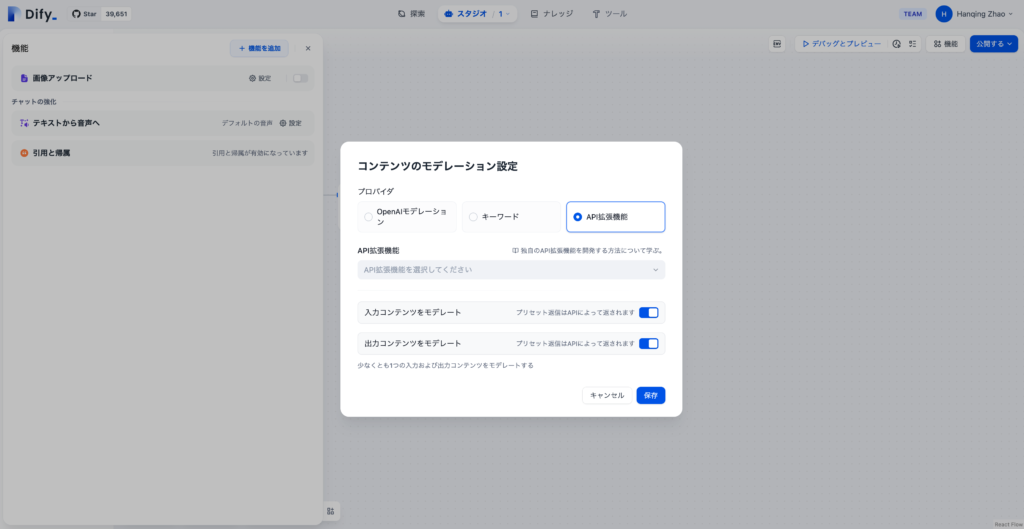

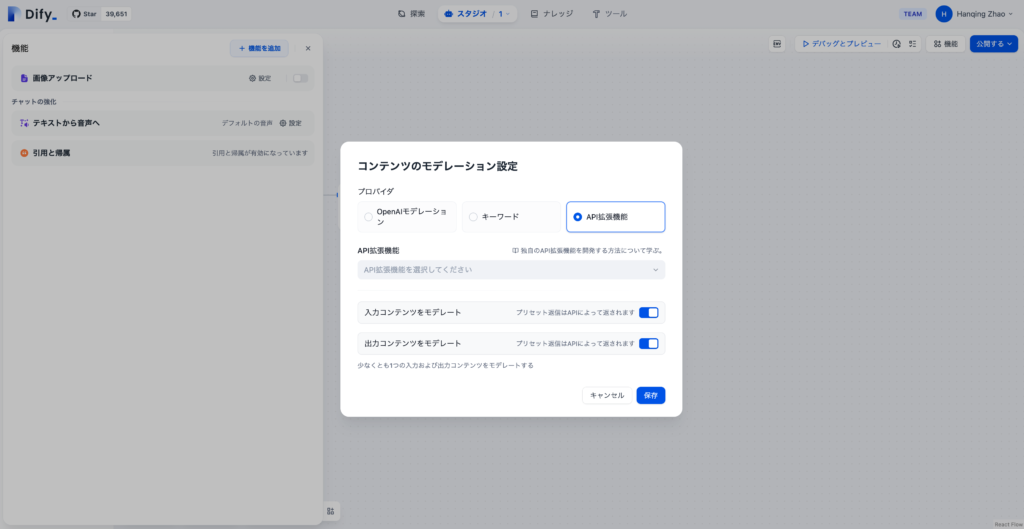

3. 外部APIによる高度な審査(拡張機能)

企業独自のセキュリティポリシーに基づいた、より高度な審査を行いたい場合は、自社の審査システムとAPI連携させることができます。

例えば、社内の認証基盤と連携して「特定の社員以外にはこの情報を表示しない」といった制御も、API拡張機能を使えば実現可能です。

まとめ:安全なAI運用はモデレーションから

AIの回答精度を高めるだけでなく、リスクを管理することも「システム化」の重要な要素です。

まずは手軽な「OpenAI モデレーション」と「キーワード設定」から導入し、安全で信頼できるAIチャットボットを構築しましょう。

【推奨】業務システム化に有効なアイテム

生成AIを学ぶ

起業のためのシステム化

【シゴトAI】実務で使えるAIスキルを最短習得!評判と特徴 – 起業のためのシステム化

実務直結のAI教育「シゴトAI」を解説。スマホ受講やLINEサポートで、初心者でも仕事や副業に活かせるスキルを習得可能。あなたに合った活用法が見つかります。

起業のためのシステム化

45歳からの生成AI!ライフシフトラボで「稼ぐ力」を習得 – 起業のためのシステム化

40代〜60代特化!知識ゼロから3ヶ月で「稼げるAIスキル」を習得するライフシフトラボ。経験×AIで起業・副業を加速させましょう。無料説明会受付中。

起業のためのシステム化

デジハクでAIを仕事に!未経験からプロを目指すマンツーマン講座 – 起業のためのシステム化

未経験からAIスキルで稼ぐ力をつけるオンラインスクール「デジハク」。マンツーマン指導と充実のアフターサポートで、副業・フリーランスへの道を最短で切り拓きます。

システム化のパートナー(ミラーマスター合同会社)

ミラーマスター合同会社|千葉のDX…

Dify自己ホスト型AIチャットボット導入支援 – ミラーマスター合同会社|千葉のDX・システム開発とデジタル…

中小企業の属人化・問い合わせ対応をAIで自動化。セキュアなDify自己ホスト型チャットボット導入を10万円で専門家が支援。

ミラーマスター合同会社|千葉のDX…

【製造業向け】業務改善・DX支援コンサル – ミラーマスター合同会社|千葉のDX・システム開発とデジタル事…

製造業の経営者様へ。生産性向上・コスト削減を実現。40年の現場経験を持つ専門家が貴社のDXを伴走支援します。

ミラーマスター合同会社|千葉のDX…

中小企業のシステム開発伴走支援 – ミラーマスター合同会社|千葉のDX・システム開発とデジタル事業創造

「誰に頼めば…」とお悩みの中小企業様へ。40年の経験を持つ代表が貴社の開発プロジェクトを成功に導きます。全国対応。

現場知×AI:製造業DX実践ブログ

製造業AI活用の本質|現場知を資産に変えるミラーマスター – 現場知×AI:製造業DX実践ブログ

現場を歩かないITは信じない。40年の経験でAI精度「32.7%の罠」を回避し、10万円から現場知を資産化する「泥臭い」エンジニアリングを提供します。

VPSサーバの選定

起業のためのシステム化

Difyに最適なVPS比較 XServer vs ConoHa

DifyでAI構築!XServer VPSとConoHa VPSを徹底比較。初心者におすすめの料金、簡単さ、スペックを解説します。

起業のためのシステム化

エックスサーバーのおすすめは?WordPress・VPS比較

国内シェアNo.1「エックスサーバー」のおすすめは?WordPressからVPS、法人利用まで、目的別に最適なプランを徹底解説。

起業のためのシステム化

ConoHaのおすすめは?WINGとVPSを徹底比較

ConoHaのおすすめは?WordPress(WING)、AI(VPS)、FXなど目的別に全サービスを比較。最適なプランが見つかります。

コメント